In questa guida trovi un elenco di controlli per identificare la causa della perdita di traffico del tuo sito web dalla ricerca organica di Google.

Hai controllato i dati di traffico e hai scoperto che, negli ultimi giorni, hai perso molti accessi dalla ricerca organica? Non farti prendere dal panico, ecco una lista di controlli che ti aiuterà a identificare la possibile causa.

Identificazione e risoluzione di problemi tecnici che influenzano il traffico del tuo sito web

Verifica se il tuo sito è affetto da una vera perdita di traffico generale che si verifica sui tuoi canali oppure se la perdita ha impattato solo aree o pagine specifiche.

- Il tuo sito è stato offline? Verifica se il tuo sito è (ed è stato) sempre online e funziona correttamente, o se potrebbe essere stato inattivo a causa di problemi tecnici. Puoi essere avvisato quando questo accade usando un “servizio di uptime” come: Pingdom Uptime Monitoring, UptimeRobot o Little Warden.

- Hai problemi di tracciamento del traffico? L’installazione di Google Analytics è corretta? Verifica se hai perso il traffico da tutte le fonti o solo dal canale organico. Verifica se il calo riguarda tutte le pagine del tuo sito o solo alcune aree. Se il calo riguarda tutto il traffico e non solo al traffico organico, usa Google Tag Manager Assistant per verificare l’installazione del tracciamento sulle tue pagine principali.

Assicurati che il tuo sito funzioni senza intoppi e tutte le pagine siano tracciate correttamente prima di proseguire.

Come i cambiamenti nel comportamento di ricerca possono influenzare il traffico del tuo sito web

Verifica se è cambiato il comportamento di ricerca degli utenti a causa della stagionalità o persino del cambio di preferenze:

- Confronta il tuo attuale andamento del traffico con quelli degli anni precedenti: utilizza il confronto delle date sul report dei contenuti di Analytics per vedere se i trend coincidono. Se c’è una differenza, verifica se ciò accade solo con il traffico organico o anche con qualsiasi altra fonte di traffico, puoi verificare la differenza di traffico di due periodi, pagina per pagina.

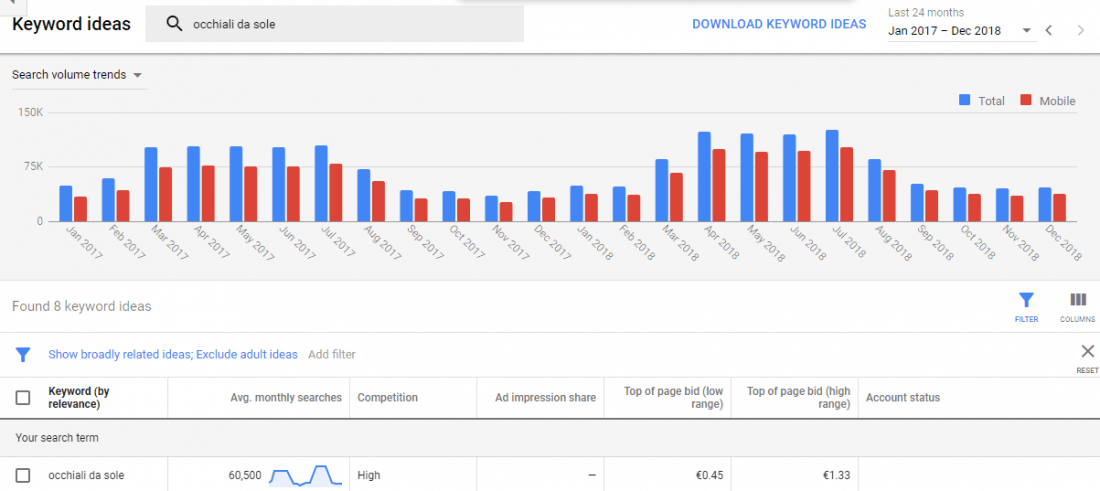

- Identifica la tendenza del volume di ricerca del pubblico per le tue query. Utilizza la funzione “Tendenze volume di ricerca” di Google Keyword Planner per vedere se coincidono con i trend del tuo traffico.

L’obiettivo dovrebbe essere quello di identificare se l’andamento negativo del traffico è dovuto a un numero inferiore di ricerche complessive a causa della stagionalità o di qualsiasi altro cambiamento nel comportamento del pubblico.

Comprendere l’impatto delle modifiche alla SERP sul traffico del tuo sito web

Verifica se vi è stato un cambiamento nel modo in cui le tue pagine, o quelle dei tuoi concorrenti, vengono visualizzate nei risultati di ricerca per le query che stai monitorando. Un cambiamento nella pagina dei risultati di ricerca potrebbe influenzare la tua e la loro visibilità e CTR.

L’obiettivo dovrebbe essere quello di verificare se il CTR delle pagine del sito nei risultati di ricerca è diminuito a causa di: una modifica delle funzionalità SERP, rich snippet, risultati zero o inclusioni in caroselli AMP, il grafico della conoscenza, mappe, immagini o risultati di video o numero di annunci paid visualizzati nelle SERP.

- Utilizza i tuoi dati di CTR ed impressioni in Google Search Console: cerca eventuali cali di CTR ed impressioni in Google Search Console (leggi la guida) rispetto alle impressioni storiche per le tue query e pagine principali e per tipo di ricerca (Web , immagine, video). Controlla anche le metriche AMP sotto “aspetto ricerca”. In certi casi le impressioni potrebbero rimanere stabili ma crolla il CTR a causa di competitor aggressivi o cambi di SERP.

- Controlla il tuo ranking e confrontalo con la concorrenza: verifica le metriche di visibilità in SERP del tuo sito con SEMrush o Sistrix e confrontale con quelle della tua concorrenza. Il calo potrebbe essere causato da un incremento di visibilità di uno o più competitor.

Prima di preoccuparti di una potenziale perdita di ranking, verifica innanzitutto se il trend negativo del traffico è dovuto ad un CTR inferiore causato da una modifica nel modo in cui le pagine vengono visualizzate nei risultati di ricerca oppure da minore visibilità rispetto ad altri siti o annunci.

La Search Engine Results Page (SERP) è la pagina che gli utenti vedono dopo aver effettuato una ricerca su un motore di ricerca come Google. Il layout di questa pagina, e come i risultati vengono visualizzati, può avere un impatto significativo sul traffico del tuo sito web.

I motori di ricerca, in particolare Google, aggiornano costantemente il modo in cui visualizzano i risultati di ricerca per migliorare l’esperienza dell’utente. Questi cambiamenti possono includere l’aggiunta di nuovi tipi di risultati, come i risultati locali o i risultati delle immagini, o la modifica del modo in cui i risultati organici vengono visualizzati.

Ad esempio, Google ha recentemente iniziato a mostrare i “risultati zero” o “snippet in primo piano” per alcune ricerche. Questi sono risultati che vengono visualizzati in cima alla SERP e che forniscono una risposta diretta alla domanda dell’utente.

Per analizzare i cambiamenti nel layout SERP, è importante monitorare costantemente le SERP per le parole chiave rilevanti per il tuo sito web. Ciò può includere l’uso di strumenti di monitoraggio SERP o semplicemente l’esecuzione di ricerche manuali regolari.

Se noti un cambiamento nel layout SERP che potrebbe influire sul tuo sito web, dovresti essere pronto a fare i necessari aggiustamenti. Ad esempio, se Google inizia a mostrare più risultati locali per le tue parole chiave target, potresti voler investire più risorse nella SEO locale.

Immagina di gestire un sito web di ricette e di aver notato un calo del traffico. Dopo aver esaminato le SERP per le tue parole chiave target, noti che Google ha iniziato a mostrare più snippet in primo piano per queste ricerche.

Gli snippet in primo piano sono box di risposte che appaiono in cima ai risultati di ricerca di Google e forniscono una risposta diretta alla domanda dell’utente. Se il tuo sito web non è ottimizzato per questi snippet, potresti perdere traffico a favore dei siti che lo sono.

In questo caso, potresti voler rivedere il contenuto del tuo sito per assicurarti che risponda direttamente alle domande degli utenti e che sia formattato in un modo che Google possa facilmente estrarre e utilizzare per gli snippet in primo piano.

Analisi del calo del posizionamento nei risultati di ricerca organica e strategie di recupero

Se non si è verificato un problema di tracciamento, non è cambiato il comportamento di ricerca degli utenti o le funzionalità SERP, è quindi il momento di verificare se il calo del traffico organico è dovuto ad un reale cambiamento negativo nel posizionamento.

- Controlla il tuo posizionamento: verifica il posizionamento per parole chiave (query), pagine, in ogni dispositivo e tipo di ricerca con la sezione “Performance” di Google Search Console, SEMrush o Sistrix. Controlla i dati storici e le variazioni di ranking per capire se il calo è specifico per parole chiave e pagine oppure se è generico per tutto il sito web.

- Confronta la tua visibilità con quella dei tuoi concorrenti: confrontando il tuo ranking con quello dei tuoi competitor per capire se hanno perso anche loro oppure se sono cresciuti.

Se è possibile identificare un calo reale di ranking, sia in determinate pagine che nel sito generale, è necessario trovare le cause per risolvere i problemi.

Risoluzione dei problemi di crawling che impediscono l’indicizzazione dei tuoi contenuti

Hai cambiato la struttura del tuo sito Web, migrato verso HTTPS o un altro dominio senza seguire le migliori pratiche SEO? Hai cambiato la CDN o hosting senza verificare che la loro configurazione consentisse l’accesso ai bot di ricerca e ora Google non può raggiungere le tue pagine?

Verifica se la perdita di traffico organico e di posizionamento è dovuta a problemi di crawling.

- Controlla la copertura dell’indice di Google Search Console e degli errori e delle statistiche di scansione: rivedi i tuoi errori e statistiche di scansione ed il nuovo rapporto “Copertura dell’indice” di Google Search Console per individuare potenziali errori di scansione relativi alle pagine per cui hai identificato un calo di traffico. Controlla quale tipo di errore è: Errori del server (5xx), richieste non autorizzate (401), URL non trovati (404), URL bloccati da robots.txt, errori di reindirizzamento, 404 soft, …

- Utilizza la funzione “Visualizza come Google” in Google Search Console: verifica se i problemi di crawlability si presentano anche con “Fetch as Google” di Google Search Console selezionando la funzionalità “Recupera e visualizza”, con il bot desktop e smartphone. Verifica che le pagine siano correttamente accessibili. Se come problema è stato segnalato un blocco di Robots.txt, verifica la configurazione del robots.txt con Google Search Console Robots Testing Tool.

- Simula una scansione con i crawler SEO: verifica se stai bloccando Googlebot eseguendo la scansione del sito simulando sia i dispositivi mobili che quelli desktop con crawler SEO come Screaming Frog.

- Analizza i log del tuo web server: se i risultati non sono ancora chiari controlla i log del tuo web server per individuare problemi di scansione. Cerca di capire se esiste una correlazione tra i dati di crawling ed il posizionamento.

Dopo aver risolto e verificato che i problemi siano stati eliminati, ricorda di utilizzare l’opzione “Convalida correzione” dal nuovo rapporto “Copertura dell’indice” di Google Search Console per le pagine interessate. Google eseguirà una nuova scansione per verificare se ora gli URL sono correttamente accessibili e indicizzabili.

Come risolvere i problemi di indicizzazione per migliorare la visibilità del tuo sito web

Hai de-indicizzato le tue pagine per sbaglio o hai modificato l’implementazione dei contenuti basandoti su framework o soluzioni Javascript?

Verifica se Google non sta indicizzando correttamente il contenuto delle pagine interessate dalla perdita di traffico:

- Verifica se il numero di URL indicizzati del tuo sito è diminuito con il rapporto “Copertura dell’indice” di Search Console di Google e il motivo specificato per cui sono stati esclusi dall’indice.

- Se Google Search Console segnala le tue pagine come non indicizzate: utilizza la copertura dell’indice di Google Search Console e lo strumento di ispezione URL di Google per identificare il motivo specifico per cui gli URL delle pagine interessate sono stati esclusi dall’indice. Se le pagine sono state de-indicizzate, se c’è una pagina alternativa selezionata come canonica, se Google ha scelto un altro URL come canonico diverso da quello specificato, ecc. a causa di un problema di configurazione trascurato che è possibile modificare. Una pagina od un intero sito web possono venire de-indicizzati con il meta tag NOINDEX o con una richiesta di de-indicizzazione in Google Search Console. È consigliabile eseguire una scansione del sito con un crawler SEO anche per verificare tutte le pagine interessate con problemi di indicizzazione e la loro specifica meta robot e configurazione di canonicalizzazione.

- Verifica se i tuoi contenuti si basano su JavaScript: una implementazione errata di JavaScript potrebbe causare la mancata indicizzazione del contenuto. Prova a disattivare JavaScript dal tuo browser e naviga il sito; puoi utilizzare l’estensione Web Develpers per Chrome per farlo facilmente – e verifica se il contenuto delle tue pagine è visualizzato correttamente. Confronta il codice HTML della tua pagina mostrato nella cache di Google (usa l’ operatore di ricerca “site:” o “cache:”per cercarli) e confrontalo con quello mostrato nel DOM (utilizzando Chrome DevTools). Verifica il codice HTML anche con il Google Mobile Friendly Test e gli strumenti di prova dei risultati di Google che mostrano rispettivamente l’HTML sottoposto a rendering per dispositivi mobili e desktop. Alcuni crawler SEO già permettono di fare questa verifica facilmente, come Screaming Frog. Considera che:

- Google utilizza un servizio di rendering Web basato su Chrome, la versione attuale è la 41 ma potrebbe cambiare in futuro. Dovresti eseguire questo test utilizzando idealmente la stessa versione di Chrome.

- Google indicizza una pagina in Javascript in due momenti diversi, come menzionato da John Mueller durante Google I/O 2018: “se la pagina contiene JavaScript, il rendering viene differito fino a quando Google non dispone delle risorse per rendere il contenuto lato client”.

Dopo aver risolto i problemi di indicizzazione, ricorda anche in questo caso l’opzione “Convalida correzione” dal nuovo rapporto “Copertura dell’indice” di Google Search Console.

Verifica e correzione della configurazione di Google Search Console per ottimizzare il traffico

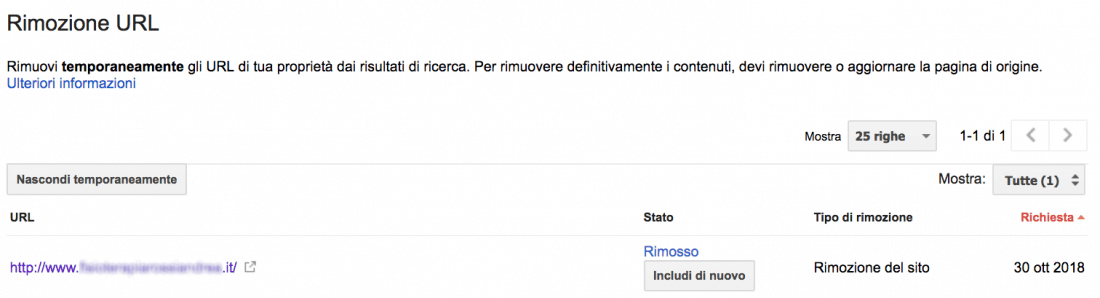

Verifica se hai modificato le impostazioni di Google Search Console in quanto esistono funzionalità che, se configurate in modo errato, potrebbero influire negativamente sulla visibilità della ricerca organica esistente, ad esempio:

- Impostazione di una preferenza errata per i parametri degli URL.

- “Rinnegare” un alto numero di backlink con il disavow tool di Google.

- Impostazione di un targeting internazionale con paese errato.

Migliorare la sicurezza del sito web per prevenire perdite di traffico

La sicurezza del tuo sito web è un aspetto cruciale che può influenzare direttamente il tuo traffico. Google e altri motori di ricerca danno la priorità ai siti web sicuri per proteggere gli utenti da potenziali minacce come malware o spam. Se il tuo sito web viene compromesso, potrebbe essere penalizzato nei risultati di ricerca, causando una perdita significativa di traffico.

Google Search Console offre un’area dedicata chiamata “Problemi di sicurezza” dove puoi verificare se Google ha rilevato problemi di sicurezza sul tuo sito web. Questi problemi possono includere malware, phishing, URL sospetti e contenuti indesiderati iniettati nel tuo sito.

Verifica se Google ha rilevato problemi di sicurezza (dovuti a malware o spam) controllando l’area “Problemi di sicurezza” di Search Console di Google. In tal caso, dovresti seguire la procedura qui specificata per risolvere i problemi e richiedere una revisione.

Supponiamo che Google rilevi un problema di malware sul tuo sito. In questo caso, riceverai una notifica nella sezione “Problemi di sicurezza” di Google Search Console. La notifica ti fornirà dettagli sul problema, incluso il tipo di malware rilevato e le pagine del tuo sito web che sono state compromesse.

Una volta identificato il problema, dovresti prendere immediatamente misure per risolverlo. Questo potrebbe includere l’aggiornamento del tuo software, la rimozione di codice sospetto o la pulizia delle pagine compromesse.

Ad esempio, se il problema è dovuto a malware, potresti dover utilizzare un servizio di pulizia del malware per rimuovere il malware dal tuo sito. Dopo aver risolto il problema, dovresti richiedere una revisione attraverso Google Search Console. Google rivedrà il tuo sito e, se il problema è stato risolto, rimuoverà la penalità.

Per prevenire futuri problemi di sicurezza, dovresti implementare misure di sicurezza come l’uso di HTTPS, l’aggiornamento regolare del tuo software e l’implementazione di misure di sicurezza come firewall e scansione del malware. Questo non solo proteggerà il tuo sito da potenziali minacce, ma ti aiuterà anche a mantenere la tua posizione nei risultati di ricerca e a prevenire perdite di traffico.

Come rilevare e risolvere le penalità manuali che influenzano il traffico del tuo sito web

Se la perdita di traffico coincide con un calo di posizionamento ma non riesci a trovare problemi di scansione o indicizzazione, potresti verificare se il tuo sito è stato penalizzato per non aver seguito le linee guida per i webmaster di Google. I motivi possono essere molti, dall’avere backlink innaturali, keyword stuffing e cloaking. Controlla se hai ricevuto un messaggio di avviso a riguardo nella sezione “azioni manuali” di Search Console di Google.

In tal caso, ti verrà fornito il tipo di azione, i motivi e le aree del sito interessate e sarà necessario eseguire le opportune operazioni di pulizia o ottimizzazione prima di richiedere una revisione pre la reinclusione.

Le penalizzazioni algoritmiche e manuali sono sanzioni che Google impone a un sito web quando determina che il sito ha violato le sue linee guida per i webmaster. Queste penalizzazioni possono avere un impatto significativo sul tuo ranking nei risultati di ricerca e, di conseguenza, sul traffico del tuo sito.

Google utilizza un algoritmo per indicizzare e classificare i siti web nei suoi risultati di ricerca. Tuttavia, Google impiega anche revisori umani che esaminano i siti web per assicurarsi che rispettino le sue linee guida. Se uno di questi revisori determina che il tuo sito ha violato le linee guida, può emettere una penalità manuale.

Le violazioni comuni che possono portare a una penalità manuale includono l’uso di tecniche di black hat SEO come il cloaking, la creazione di contenuti di scarsa qualità o duplicati, la partecipazione a schemi di link, e l’uso eccessivo di parole chiave.

Per controllare se il tuo sito ha ricevuto una penalità manuale, puoi utilizzare il rapporto sulle azioni manuali in Google Search Console. Questo rapporto ti mostrerà se il tuo sito ha ricevuto una penalità, la natura della violazione, e le pagine o le sezioni del tuo sito che sono state colpite.

Se il tuo sito ha ricevuto una penalità, dovresti prendere immediatamente provvedimenti per risolvere la violazione. Questo potrebbe includere la rimozione o la modifica dei contenuti problematici, la correzione dei problemi tecnici, o la rimozione dei link in entrata o in uscita non naturali. Una volta che hai risolto il problema, puoi inviare una richiesta di riesame a Google attraverso la Search Console.

Immagina di gestire un blog e di aver notato un calo significativo del traffico. Dopo aver controllato il rapporto sulle azioni manuali in Google Search Console, scopri che il tuo sito ha ricevuto una penalità per “contenuto sottile con poco o nessun valore aggiunto”.

In questo caso, dovresti esaminare il tuo sito per identificare e rimuovere o migliorare qualsiasi contenuto di scarsa qualità. Questo potrebbe includere post di blog brevi o superficiali, pagine duplicate, o pagine con contenuto generato automaticamente.

Una volta che hai migliorato il tuo contenuto, puoi inviare una richiesta di riesame a Google. Nella tua richiesta, dovresti spiegare le azioni che hai intrapreso per risolvere il problema e assicurarti che non si ripeta in futuro.

Adattarsi agli aggiornamenti degli algoritmi di Google per mantenere o migliorare il traffico del tuo sito web

Infine, se non hai ricevuto alcun messaggio di azione manuale – ma la perdita di traffico coincide con un calo di ranking e non ci sono problemi di scansione e indicizzazione, verifica se ci sono stati aggiornamenti degli algoritmi di ricerca di Google. Controlla la correlazione degli aggiornamenti dell’algoritmo di Google con il tuo calo di traffico.

Per farlo, puoi controllare i seguenti siti che documentano gli aggiornamenti di Google per cercare le coincidenze:

- Google PageRank & Algorithm Updates – Search Engine Roundtable

- Google Algorithm Change History – Moz

- Google Algorithm Changes – AWR

Controlla i trend di visibilità organica con SEMrush e Sistrix, verifica se ci sono cambi di trend in coincidenza con il rilascio di aggiornamenti di Google. Inoltre, ti consiglio di provare lo strumento Panguin per identificare le pagine che hanno perso traffico.

Il monitoraggio degli aggiornamenti degli algoritmi di Google è una parte fondamentale della strategia SEO. Google rilascia costantemente aggiornamenti del suo algoritmo di ricerca per migliorare la qualità dei risultati di ricerca per gli utenti. Alcuni di questi aggiornamenti sono minori e potrebbero non avere un impatto significativo sul posizionamento del tuo sito web nei risultati di ricerca. Tuttavia, ci sono anche aggiornamenti più significativi, noti come “core updates”, che possono avere un impatto sostanziale sul posizionamento del tuo sito web.

Monitorare gli aggiornamenti degli algoritmi è fondamentale per una strategia SEO efficace. Quando sei al corrente dei cambiamenti nell’algoritmo di Google, puoi adattare la tua strategia per massimizzare i benefici o minimizzare i danni. Per esempio, se un aggiornamento premia i siti con contenuti di alta qualità e penalizza quelli con contenuti duplicati o di bassa qualità, è importante che il tuo sito offra contenuti unici e di valore.

Per monitorare gli aggiornamenti degli algoritmi, puoi utilizzare vari strumenti SEO come Sistrix, Mozcast, SEMrush Sensor o Algoroo. Questi strumenti monitorano i cambiamenti nei risultati di ricerca di Google e forniscono aggiornamenti quando rilevano fluttuazioni significative che potrebbero indicare un aggiornamento dell’algoritmo.

Supponiamo che tu stia monitorando i tuoi ranking di Google utilizzando SEMrush Sensor e noti un punteggio di volatilità elevato. Questo potrebbe essere un indicatore che Google ha rilasciato un aggiornamento dell’algoritmo. Per confermare questo, potresti controllare altri strumenti come Mozcast o Algoroo per vedere se hanno rilevato fluttuazioni simili.

Una volta confermato che c’è stato un aggiornamento dell’algoritmo, il passo successivo sarebbe capire cosa è cambiato. Potresti fare questo leggendo blog SEO affidabili o seguendo account Twitter come @searchliaison, che è l’account ufficiale di Google per le comunicazioni sulla ricerca.

Dopo aver capito cosa è cambiato nell’aggiornamento dell’algoritmo, potresti adattare la tua strategia SEO di conseguenza. Ad esempio, se l’aggiornamento premia i siti web con contenuti di alta qualità, potresti voler investire più tempo e risorse nella creazione di contenuti di alta qualità per il tuo sito web.

Verifica degli errori di tracciamento

La verifica degli errori di tracciamento è un aspetto fondamentale per mantenere la salute del tuo sito web e per comprendere il comportamento degli utenti. Quando parliamo di “codici di tracciamento”, ci riferiamo principalmente ai codici JavaScript che vengono inseriti nel tuo sito web per monitorare il comportamento degli utenti. Questi codici sono utilizzati da strumenti come Google Analytics, Google Tag Manager, Facebook Pixel, e molti altri.

Il tracciamento del sito web è fondamentale per comprendere come gli utenti interagiscono con il tuo sito. Questo include informazioni come da dove provengono gli utenti (ad esempio, da motori di ricerca, social media, referral diretti), quali pagine visitano, quanto tempo trascorrono sul tuo sito, e quali azioni intraprendono (ad esempio, cliccare su un link, compilare un modulo, effettuare un acquisto).

Tutte queste informazioni sono raccolte e analizzate per aiutarti a ottimizzare il tuo sito web, migliorare l’esperienza dell’utente, e in ultima analisi, raggiungere i tuoi obiettivi di business.

La verifica degli errori di tracciamento implica la conferma che i tuoi codici di tracciamento sono presenti e funzionanti correttamente. Se un codice di tracciamento viene rimosso o si rompe, potresti non essere in grado di raccogliere dati sugli utenti, il che potrebbe portare a una mancanza di informazioni o a dati inaccurati.

Per verificare se i tuoi codici di tracciamento sono presenti e funzionanti, puoi utilizzare strumenti come Google Tag Assistant o l’ispezione degli elementi nel tuo browser. Questi strumenti ti permettono di vedere i codici di tracciamento sul tuo sito e di verificare se stanno funzionando correttamente.

Immagina di avere un sito web di e-commerce e di aver notato un calo del traffico. Dopo aver controllato le tue fonti di traffico in Google Analytics, noti che non stai ricevendo dati da alcune delle tue pagine di prodotto.

Per verificare se il problema è dovuto a un errore di tracciamento, potresti utilizzare Google Tag Assistant per controllare le tue pagine di prodotto. Se scopri che il codice di tracciamento di Google Analytics non è presente o non funziona correttamente su queste pagine, questo potrebbe spiegare il calo del traffico.

In questo caso, dovresti lavorare con il tuo sviluppatore web o con il tuo team SEO per risolvere il problema, che potrebbe includere la reinserimento del codice di tracciamento, la risoluzione di conflitti con altri script sul tuo sito, o l’aggiornamento del tuo codice di tracciamento a una versione più recente.

Controllo delle regole robots.txt

Il file robots.txt è un file fondamentale che aiuta i motori di ricerca a capire quali parti del tuo sito web dovrebbero essere esplorate e indicizzate, e quali dovrebbero essere ignorate. Questo file è particolarmente importante per i motori di ricerca come Google, che utilizzano robot (o “spiders”) per esplorare il web e indicizzare i contenuti.

La teoria dietro le regole robots.txt è piuttosto semplice: fornire un mezzo per i proprietari dei siti web di comunicare direttamente con i motori di ricerca. Questo file, che risiede nella directory principale del tuo sito, fornisce istruzioni ai robot dei motori di ricerca su quali pagine o directory del tuo sito possono o non possono essere esplorate.

Ad esempio, potresti voler impedire ai motori di ricerca di esplorare e indicizzare le pagine del tuo sito che contengono informazioni sensibili o non pertinenti, o le pagine che sono in fase di sviluppo. In questo caso, potresti utilizzare il file robots.txt per “disallow” (o “proibire”) ai robot di esplorare queste pagine.

Per controllare le regole del tuo file robots.txt, dovresti accedere direttamente al file sul tuo server web. Il file robots.txt è generalmente accessibile inserendo “/robots.txt” alla fine dell’URL del tuo sito (ad esempio, www.tuosito.com/robots.txt).

Una volta che hai accesso al file, dovresti controllare le linee che iniziano con “Disallow”. Queste linee indicano ai robot dei motori di ricerca quali pagine o directory non dovrebbero esplorare. Ad esempio, una linea che dice “Disallow: /private/” direbbe ai robot di non esplorare la directory “private” del tuo sito.

Immagina di avere un sito web con una sezione “Notizie” che stai attualmente ristrutturando. Durante questo periodo, non vuoi che le pagine di notizie vengano esplorate o indicizzate dai motori di ricerca. In questo caso, potresti aggiungere la seguente linea al tuo file robots.txt:

Disallow: /notizie/Questa linea direbbe ai robot dei motori di ricerca di non esplorare la directory “notizie” del tuo sito.

Tuttavia, dopo aver completato la ristrutturazione, dimentichi di rimuovere questa linea dal tuo file robots.txt. Di conseguenza, le tue pagine di notizie continuano a essere ignorate dai motori di ricerca, il che potrebbe portare a un calo del traffico del tuo sito. In questo caso, dovresti controllare il tuo file robots.txt e rimuovere la linea “Disallow: /notizie/” per permettere ai motori di ricerca di esplorare e indicizzare di nuovo le tue pagine di notizie.

Verifica degli errori di reindirizzamento

I reindirizzamenti sono un aspetto fondamentale della gestione di un sito web, specialmente quando si tratta di SEO. Un reindirizzamento avviene quando un utente o un motore di ricerca tenta di accedere a una pagina del tuo sito web, ma viene automaticamente indirizzato a una pagina diversa.

I reindirizzamenti sono spesso utilizzati quando una pagina è stata spostata o eliminata, per assicurarsi che gli utenti e i motori di ricerca vengano indirizzati alla pagina più rilevante. Ad esempio, se hai una pagina di prodotto per un articolo che non è più disponibile, potresti voler reindirizzare gli utenti a una pagina simile o a una pagina di categoria pertinente.

Un reindirizzamento 301, o reindirizzamento permanente, è il tipo di reindirizzamento più comune utilizzato nella SEO. Un reindirizzamento 301 indica ai motori di ricerca che una pagina è stata spostata definitivamente a un nuovo URL. Questo è importante perché aiuta a preservare il “juice” del link della pagina originale, che è un fattore chiave nel ranking dei motori di ricerca.

La verifica degli errori di reindirizzamento è un passo fondamentale per assicurarsi che il tuo sito web funzioni come previsto. Se un reindirizzamento non funziona correttamente, gli utenti e i motori di ricerca potrebbero non essere in grado di accedere alle pagine che stanno cercando, il che potrebbe portare a una cattiva esperienza utente e a un calo del traffico del sito.

Per verificare i tuoi reindirizzamenti, puoi utilizzare un web crawler come Screaming Frog. Questo strumento può esplorare il tuo sito web e identificare qualsiasi problema con i tuoi reindirizzamenti, come reindirizzamenti rotti o loop di reindirizzamento.

Immagina di avere un sito web di e-commerce e di aver recentemente ristrutturato le tue pagine di categoria. Come parte di questa ristrutturazione, hai spostato alcune delle tue pagine di categoria a nuovi URL e hai impostato dei reindirizzamenti 301 dalle vecchie pagine alle nuove.

Per assicurarti che questi reindirizzamenti stiano funzionando come previsto, potresti utilizzare Screaming Frog per esplorare il tuo sito. Se Screaming Frog identifica problemi con i tuoi reindirizzamenti, come reindirizzamenti a pagine che non esistono o loop di reindirizzamenti, dovresti correggere questi problemi il più presto possibile per evitare di perdere traffico.

Gestione della cannibalizzazione delle parole chiave

La cannibalizzazione delle parole chiave è un problema comune nella SEO che può avere un impatto negativo sul tuo traffico organico. Questo problema si verifica quando più pagine del tuo sito web competono per le stesse o simili parole chiave, il che può confondere i motori di ricerca e diluire il tuo traffico.

I motori di ricerca come Google cercano di mostrare la pagina più rilevante per una determinata ricerca. Se più pagine del tuo sito web mirano alla stessa parola chiave, i motori di ricerca potrebbero avere difficoltà a determinare quale pagina è la più rilevante. Di conseguenza, potrebbero finire per mostrare una pagina meno ottimizzata o rilevante, o peggio, potrebbero decidere di mostrare una pagina di un altro sito.

Inoltre, se le tue pagine stanno competendo per le stesse parole chiave, potrebbero finire per rubarsi traffico a vicenda. Invece di avere una pagina che si classifica in alto per una parola chiave e attira molto traffico, potresti finire con molte pagine che si classificano più in basso e attirano meno traffico.

La gestione della cannibalizzazione delle parole chiave richiede una strategia di contenuto ben pensata e un’attenta ottimizzazione delle parole chiave. Dovresti cercare di avere una pagina chiara e definita per ogni parola chiave o gruppo di parole chiave che stai cercando di targettizzare.

Se noti che più pagine del tuo sito web stanno competendo per le stesse parole chiave, potresti voler considerare la fusione di queste pagine in una sola pagina più completa e autorevole. Alternativamente, potresti voler rivedere le tue parole chiave e assicurarti che ogni pagina stia mirando a una parola chiave unica e rilevante.

Immagina di gestire un blog di ricette e di aver recentemente pubblicato molte ricette di pasta. Dopo aver esaminato le tue parole chiave, noti che molte di queste ricette stanno competendo per la parola chiave “ricetta pasta”.

In questo caso, potresti voler considerare la creazione di una pagina di categoria o di un post di blog che raccolga tutte le tue ricette di pasta in un unico posto. Questa pagina potrebbe poi diventare la tua pagina principale per la parola chiave “ricetta pasta”, mentre le singole ricette potrebbero mirare a parole chiave più specifiche, come “ricetta pasta al pomodoro” o “ricetta pasta alla carbonara”.

Verifica delle modifiche alla mappa del sito XML

La mappa del sito XML è uno strumento essenziale per la SEO che aiuta i motori di ricerca a capire la struttura del tuo sito web e a trovare tutte le pagine che dovrebbero essere indicizzate.

Una mappa del sito XML è essenzialmente un elenco di URL del tuo sito web che vuoi che i motori di ricerca esplorino e indicizzino. Questa mappa fornisce ai motori di ricerca un percorso facile per trovare tutte le pagine del tuo sito, specialmente se il tuo sito è grande o ha molte pagine che sono profondamente interconnesse.

Oltre agli URL, una mappa del sito XML può anche includere informazioni aggiuntive su ciascuna pagina, come quando è stata aggiornata per l’ultima volta e quanto spesso cambia. Queste informazioni possono aiutare i motori di ricerca a capire quali pagine dovrebbero esplorare più spesso.

Per verificare la tua mappa del sito XML, dovresti prima accedere al file sul tuo server web. La mappa del sito XML è generalmente accessibile inserendo “/sitemap.xml” alla fine dell’URL del tuo sito (ad esempio, www.tuosito.com/sitemap.xml).

Una volta che hai accesso alla mappa del sito, dovresti controllare se tutti gli URL che restituiscono una risposta 200 OK sono inclusi. Se trovi URL mancanti o se hai recentemente aggiunto nuove pagine al tuo sito che non sono nella mappa del sito, dovresti aggiornare e inviare nuovamente la mappa del sito.

Puoi inviare la tua mappa del sito a Google utilizzando Google Search Console. Dopo aver inviato la mappa del sito, Google la esplorerà e utilizzerà le informazioni per indicizzare meglio il tuo sito.

Immagina di gestire un blog e di aver recentemente pubblicato una serie di nuovi post. Dopo aver controllato la tua mappa del sito XML, noti che questi nuovi post non sono inclusi.

In questo caso, dovresti aggiornare la tua mappa del sito per includere gli URL di questi nuovi post. Puoi farlo manualmente se la tua mappa del sito è piccola, o potresti utilizzare uno strumento di generazione della mappa del sito se il tuo sito è grande.

Una volta che la tua mappa del sito è aggiornata, dovresti inviarla a Google tramite Google Search Console. Questo assicurerà che Google sia a conoscenza dei tuoi nuovi post e possa indicizzarli correttamente.

Risolvere i problemi della SEO può sembrare un compito arduo, ma con la giusta strategia e gli strumenti appropriati, è possibile identificare e affrontare efficacemente le cause della perdita di traffico. Ricorda, la SEO è un processo continuo che richiede monitoraggio e aggiustamenti regolari. Non esiste una soluzione unica per tutti, quindi è importante analizzare attentamente i dati e adattare la tua strategia di conseguenza. Infine, non dimenticare che il contenuto di qualità e un’ottima esperienza utente sono sempre al centro di una buona SEO. Continua a ottimizzare, a testare e a imparare, e vedrai i tuoi sforzi ripagati con un aumento del traffico e una migliore visibilità nei motori di ricerca.

Hai consultato tutta la checklist? Allora dovresti essere stato in grado di identificare la causa del calo del traffico del tuo sito. Se ti è capitato un caso non trattato in questa guida fammi sapere con un commento.

Articoli correlati

Autore

Commenti |8

Lascia un commentoCiao Giovanni,

ti scrivo perchè la mia situazione è particolarmente unica, ti spiego velocemente.

Perdita di traffico pari al 50%: da 60.000 sessioni/mese a circa 30.000, senza però perdita di posizionamento, anzi, manteniamo la leadership da ormai 13 anni su centinaia e centinaia di query ad alto valore.

In Search Console è tutto ok, sitemap, indicizzazione, azioni manuali, backlink, e mostra il trend di miglioramento anche in merito all’esperienza sulle pagine (vicino al 90%). Su SemRush e altri tool SEO mi viene confermato l’ottimo posizionamento con piccole e normali oscillazioni nelle SERP.

Ho pensato ad un Trend di ricerca drasticamente calato ma… sincronizzato? dal 28 Ottobre c’è stato il calo repentino.

Il Codice di tracciamento Analytics lavora correttamente (insieme al tag manager)… è la prima volta che mi accade una così così… sapresti dirmi la tua?

Ti ringrazio anticipatamente.

Ciao Luca, grazie per la domanda.

Ti dirò la mia, anche se penso tu abbia già trovato la risposta. I tool SEO tracciano la visibilità organica, che è data dal numero di parole chiave posizionate da un dominio, la loro posizione media in SERP ed il loro traffico di ricerca medio mensile.

Se gli indicatori di visibilità restano stabili o crescono, ma il traffico organico registrato cala, può significare due cose:

1) i trend di ricerca sono cambiati. Tu resti si ben posizionato, ma per meno ricerche. Alla lunga anche i tool registrano che le query sono meno forti, e l’indice di visibilità cala.

2) la SERP è cambiata, e le ricerche zero click sono aumentate. Questo può essere causato da risultati Featured Snippet (i risultati zero, con più testo mostrato all’utente) che rispondono direttamente all’utente che non avrà bisogno di aprire la pagina. Oppure dal knowledge graph, il local pack o altri elementi dell’universal search.

Per prima cosa cercherei di capire se è un trend stagionale. In tal caso serve pazienza. Alla peggio devi cercare nuove query.

Ciao Giovanni e grazie per la risposta… non ci sto dormendo a causa di questa storia. Non so perchè ma “la testa mi dice” che c’è qualcosa che non va con Analytics.

I trend di ricerca sono stabili ed infatti noi continuiamo a generare lead tranquillamente, senza variazioni, ma in Analytics vedo il calo drastico (del 50% del traffico globale) e addirittura nelle sorgenti di traffico i social sono passati al primo posto, poi organico etc..etc.. (anche questo è impossibile).

Nelle query delle visite organiche 18.000 click (nell’ultimo mese) sono “not provided”, booooo

In qualsiasi caso ti ringrazio molto per avermi dedicato tempo…

Ciao Luca, un eventuale problema con Analytics lo puoi diagnosticare solo tu analizzando il codice delle tue pagine. Le mie erano considerazioni più di carattere generale.

Se confronti i trend (non i valori nello specifico) di traffico organico in Google Analytics > Canali > Organico con quelli di Google Search Console > Performance, trovi un punto in cui noti discrepanze e cambi evidenti di trend tra le due fonti?

Ciao Giovanni, scusa il ritardo nella risposta…

In Analytics / Canali / Organico registro appunto un calo del 50% del traffico da posizionamento organico mentre invece su Search Console / Rendimento vedo una costante crescita e le solite centinaia di query in prima posizione (o giù di li) che performano come sempre, anzi meglio.

Però c’è una novità (ancora più sconcertante)! in Analytics ho collegato Search Console (era già collegato ma che non interrogavo mai da Analytics) che dopo il 14 Novembre mi mostra 0 Query! 0 Pagine di destinazione! un picco in down da circa 1000 click a 0 Click!

Praticamente non vedo la luce :(

Quindi ho Search Console e tutti i Tool SEO che utilizzo (SEO Power Suite e SemRush) con i dati positivi di sempre e solo Analytics mostra cose sconcertanti! come ti scrivevo su I Social sono passati primi come fonte di traffico (una cosa per noi impossibile visto che le attività sui social sono ai minimi termini).

Grazie ancora per il tempo che mi hai dedicato…

PS: Ho controllato ovviamente lo script Analytics sul sito e nulla sembra essere fuori posto a parte l’inserimento 8/10 mesi fà del tag manager (lo dico così per dire)

Strana situazione, sembrerebbe un problema di tracciamento di GA o GTM.

Hai attivato dei filtri in GA?

Hai verificato il trigger dello script GA in GTM?

Ciao Giovanni, ho letto il tuo articolo proprio perchè sto cercando rimedio al problema. Ho avuto un problema tecnico per circa un mese dovuto probabilmente all’hosting provider. Il sito presentava una pagina bianca. Essendo a cavallo delle vacanze di Natale ci ho messo un po’ a realizzarlo. Poi per la soluzione del problema ci è voluto ancora un po’ di tempo. Morale sono passato da 150 visite al giorno a meno di dieci. Cosa posso fare per recuperare la situazione ante-problema?

Grazie per una tua risposta

Alberto

Ciao Alberto, se i contenuti del sito sono spariti per diversi giorni, Google potrebbe aver rimosso lepagine dall’indice o comunque aver rimosso i buoni posizionamenti che aveva.

ora non ti resta che ripristinare tutto, aggiornare la sitemap.xml e attendere che Google faccia il suo lavoro. La visibilità dovrebbe tornare se nella tua nicchia di mercato non sono cambiate troppe cose.